AI普及による様々なリスクとは?

予想される未来社会の変化

- 急速にAIが発展したことで、これまでなかったAIのブラックボックス化の課題が浮上している。

- AIはとても便利で、精度も日々向上している反面、AIを過信しすぎるあまり、判断プロセス、結論に至った理由が人間にわからなくなる。ハルシネーション(もっともらしい誤情報)を見分ける判断力が必要となるが、精度の向上により見分けることがますます困難になる。

- AIを用いてあたかも現実におきたかのような虚構の動画がまん延する。AIに関する規制や法整備が今後さらに強まると予想される。

- AIに学習させ、自分の悩みを相談できるパートナーのようにみなす人が増加することで、人間同士の繋がりが希薄化する。

トレンド

アルバニアのAI大臣「ディエラ」

バルカン半島の小国アルバニアで、世界初の人工知能(AI)大臣が誕生した。ディエラ(アルバニア語で太陽の意)という名の汚職対策・公共入札担当大臣である。アルバニアは汚職が深刻なことで知られ、その政治腐敗が欧州連合(EU)加盟承認の障害となってきた。

AI導入によって“熟議”の手間を省いた“効率的”な意思決定は期待できるが、一方では「熟議の民主主義を捨てたAI権威主義」と批判の声があがっている。汚職の根源である縁故主義経済や国民文化にAIは手を付けられない点や、ハルシネーションやバイアスなどのAIリスクが存在する点、使う人間が悪意を持てば信頼性は落ちる点などから反発を受けている。

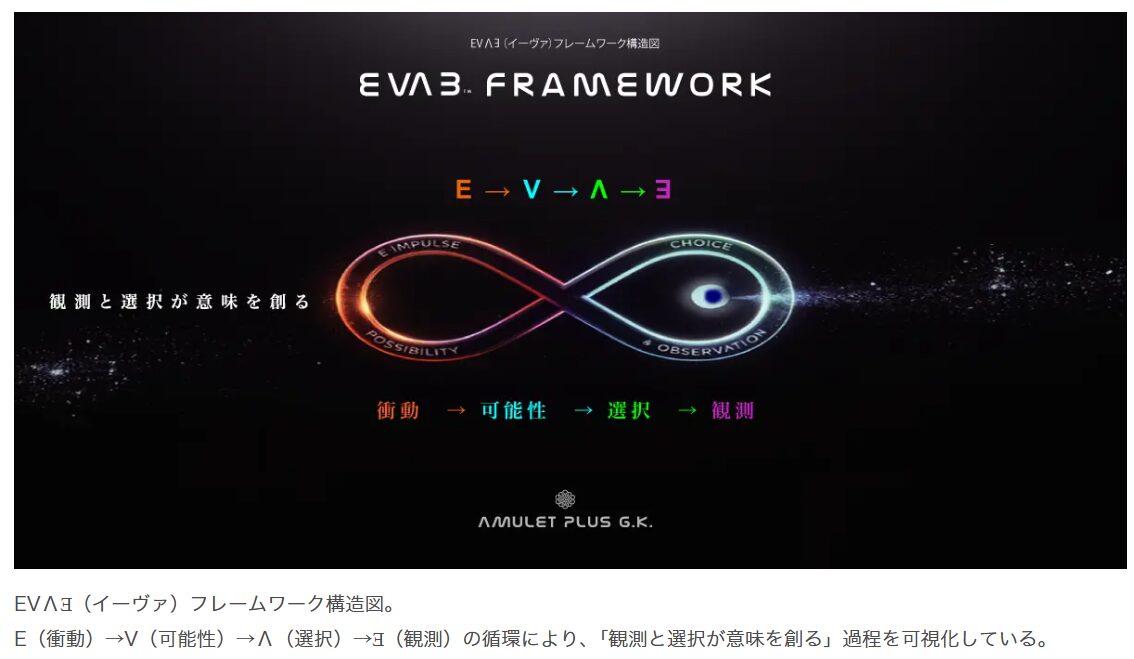

EVΛƎ(イーヴァ)フレームワーク

アミュレットプラス合同会社が開発したAIの意思決定過程を透明化する新概念「EVΛƎ(イーヴァ)フレームワーク」は、「なぜその判断に至ったのか」を説明できないというAIのブラックボックス問題を根本から解決する二重ループ情報処理システムで、意識ループと行動ループを非対称に接続する。また、展望生成モジュールにより次サイクルの候補を予測・保持し、熟慮と即応を統合する仕組みになっている。

このモデルは、E(衝動) → V(可能性) → Λ(選択) → Ǝ(観測) の四段階の循環構造を採用し、AI の判断プロセスを可視化する。さらに、「意識ループ(熟慮)」と「行動ループ(即応)」を非対称に分離し、それぞれをモジュール化することで、各判断ステップをモニタリング・追跡できるようになっている。

行動の結果は三つの経路(緊急対応/衝動生成/前提修正)に分岐し、未来候補(可能性)を生成する「展望生成モジュール」によって、次サイクルへの選択肢を生み出す構造を持つ。

このように、AIは単純な入力→出力だけでなく、「なぜその判断をしたか/その前提が正しいか」の問い直しを自律的に行えるよう設計されており、説明可能性・透明性を高めることが可能になる。

応用分野として、自動運転、医療診断、教育支援、創造支援などが想定されており、AI規制(例:EU の AI Act)への対応技術としても位置づけられている。

E2E(エンド・ツー・エンド)自動運転実現の障壁

米テスラが日本で先進運転支援システム「フルセルフドライビング」の走行実証を開始した。ドライバーは常時監視しなければならないため、「レベル2」に該当するが、認知、操作、判断をすべて人工知能(AI)が担う手法「エンド・ツー・エンド(E2E)」を用いるため、より複雑な交通環境でも運転支援機能を使用できるようになる。

ただ、米国や中国ではE2Eを使用した自動運転技術の事故も発生しているほか、AIの判断過程が見えない「ブラックボックス問題」が障壁となっている。

この説明困難性は、安全性認証、法規制対応、事故責任の所在明確化などの面で懸念材料となる。

E2E自動運転普及のためには、性能の向上に加えて、このようなAIによる判断の根拠が説明できないことや、学習データが少ない状況でスムーズに作動しない可能性の解決などが求められている。